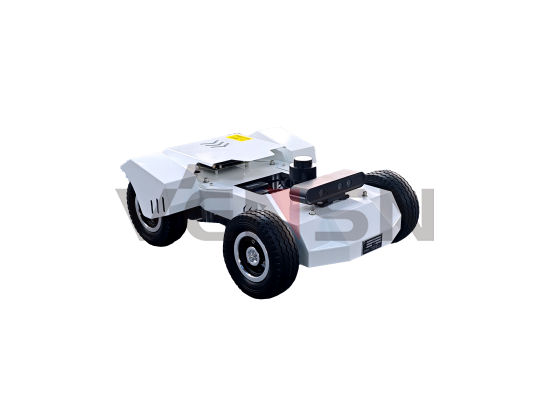

一、智能网联微缩车介绍

智能网联教具车采用阿克曼转向的线控底盘,搭载 360 度扫描式激光雷达、惯性陀螺仪、视觉摄像头,实现室内场景导航、循迹、避障、绕障、遵守交通标识等自动驾驶功能。采用先进的AI人工智能计算平台,可进行图像识别、SLAM定位、环境感知、障碍物探测、交通标识识别、多传感器融合、自动驾驶决策与控制等教学和研究,并支持二次开发。

二、主要功能

采用阿克曼结构,提供CAN线控协议,贴近智能网联汽车形态,可进行汽车线控底盘结构原理教学;

控制系统与L4自动驾驶系统框架类似,可学习感知、定位、规划、控制四大自动驾驶模块工作方式;

提供建图工具,建立具有交通规则信息的行驶地图,微缩车可依据地图自主行驶到任意目标点;

可基于联动展示台,实现AVP代客泊车倒车入库;

可实现网约车定点约车、送客等定位路径规划自动驾驶;

可基于联动展示台,实现车路协同、识别交通设施、识别行人等功能;

三、主要规格

1、小车底盘基本参数

尺寸:长*宽*高233*191*146

供电接口:5V和12V供电接口。

前转向舵机,后轮驱动。

带电池,控制板,和遥控器,可实现遥控驾驶。

2、环境感知部件

1.激光雷达

测量距离:0.15-12m

扫描角度:0-360度

测距分辨率:<0.5

角度分辨率:<=1度

测量频率:2000-8000Hz

扫描频率:1—10HZ

3、 IMU

类型:九轴传感器,加速度计,陀螺仪和磁强计

板载能力:板载ATmega328处理并通过串行流发送的所有传感器的输出

数据输出:支持FTDI、蓝牙、Xbee

输入电压:3.5-16DC

4、摄像头

最大分辨率: 1920*1080

5、控制器

CPU:ARM Cortex-A78AEV8.2 64bit@1.5GHz(六核)

GPU:搭载16个TensorCore的512核NVIDAAAmpere架构GPU@625Mhz

算力:20TOPS

内存:4GB 64-bit LPDDR5、34 GB/S

USB接口:3×USB3.0+1 USB2.0+1 Type-C

视频编码:1080p30由1-2个CPU核心提供支持

视频解码:H.265(4K60,2×4K30,5×1080p60,11×1080p30)

GPIO引脚数:40

四、实训内容

1. 机器人底层功能

底层ROS串口通信

预留CAN通信接口

IMU与里程数据反馈

电池电压检测与电压报警

支持串口一键下载

陀螺仪零点漂移清除

场景机器人底盘运动学分析

航模遥控使用

常见电路保护功能

2. 建图导航相关功能

机器人动态避障

机器人定点导航

机器人多点导航

TEB与DWA路径规划

激光雷达角度屏蔽

激光雷达建图导航

rtab纯视觉建图导航

rtab视觉+雷达建图导航

Gmapping建图

Hector建图

Karto建图

Cartographer建图

RRT自主建图

机器人编队(领航者算法)

机器人编队切换

机器人编队避障

Cartographer3D三维重建

LIO-SAM三维重建

LeGO-LOAM三维重建

3. 人机交互相关功能

键盘节点控制

APP重力感应控制

APP调节PID参数

ROSAPP图传与控制

ROS APP建图

ROS APP导航

声源定位

语音召唤

语音控制

语音导航

语音播报

语音交互

激光雷达跟随

TTS文本转音频功能

ROS Ot功能

4. 视觉处理相关功能

opencv应用与教程

网页摄像头监控

深度视觉跟随

KCF跟随

AR标签识别

RGB视觉巡线(融合雷达避障)

人体骨架识别

人体骨架跟随

3D视觉姿态控制

3D视觉建图

3D视觉导航

ORB视觉建图功能

5. 深度学习相关功能

YOLO物体识别

YOLO手势识别

YOLO交通标志识别

深度学习模型训练

手势控制

沙盘地图自动驾驶

Tensorflow物体识别

Tensorflow目标检测

Tensorflow手写数字识别